对数据库的操作:包含创建、修改数据库 对数据表的操作:分为内部表及外部表,分区表和分桶表 二、DQL语句(数据查询语句): 单表查询、关联查询 hive函数:包含聚合函数,条件函数,日期函数,字符串函数等 ...

”hive 数据库 sql“ 的搜索结果

Hive_SQL语法大全

标签: hive_sql

Hive_Sql语法详述,平时工作中遇到的问题,用于Hadoop平台的数据挖掘。

Hive SQL(HQL)与SQL的语法大同小异,基本上是相通的,学过SQL的使用者可以无痛使用Hive SQL。只不过在学习HQL语法的时候,特别要注意Hive自己特有的语法知识点,今天我们就来学习下Hive SQL的DDL语句

使用的是impala包。 如何安装impala:...def read_sql(sql): ''' 读取hive的sql,二维列表 参数: sql:sql语句 返回: DataFrame ''' from impala.dbapi import connect import pandas as pd

hive sql基本语句。

Hive能够将HDFS上结构化的数据文件映射为数据库表,并提供SQL查询功能,将SQL语句转变成MapReduce任务来执行。Hive通过简单的SQL语句实现快速调用MapReduce机制进行数据统计分析,因此不必专门开发MapReduce应用程序...

hive数据仓库工具能将结构化的数据文件映射为一张数据库表,并提供SQL查询功能,能将SQL语句转变成MapReduce任务来执行。Hive的优点是学习成本低,可以通过类似SQL语句实现快速MapReduce统计,使MapReduce变得更加...

基于Python建立hive库的连接

在大数据学习当中,尤其...Hive简介根据官方文档的定义,Hive是一种用类SQL语句来协助读写、管理那些存储在分布式存储系统上大数据集的数据仓库软件1、进入hive数据库:hive2、查看hive中的所有数据库:show databa...

一.unix_timestamp函数 1.unix_timestamp函数返回当前时间戳,...hive> select unix_timestamp(); OK 1574423914 Time taken: 0.435 seconds, Fetched: 1 row(s) 2.unix_timestamp(‘2019-11-22 00:00:...

查询语句查询语句。

最近在利用FlinkSQL进行开发连接Hive数据库的时候遇到了一些小问题,接下来分享给大家以免以后踩坑。 在一个项目中我主要利用FlinkSQL来连接Hive数据库并执行Insert动态插入语句来关联设备信息,话不多说我们直接开始...

hive常用的开发规范 hdfs hbase udf函数 hql shell脚本开发等常用规范,仅供参考

比较hive数据库与mysql数据库

这里采用Scala开发Spark程序,按照索引ID增量抽取数据插入到hive数据库中,每次增量抽取300万条数据。 如下图所示: 每次抽取300万条数据,并且每次存储最大ID到一张记录表中,在最大ID基础上实现每次增量抽取300万条...

Spark系列之:使用spark合并hive数据库多个分区的数据到一个分区中

其中sasl安装较为麻烦一点,在Linux下直接安装可能会出现sasl.h头文件丢失问题,原因是sasl的源码已经许久没有维护了,代码结构与现有的代码结构不一样,下面分别给出win及Linux下的安装方法。首先是配置相关的环境...

前言 ...本文介绍用python读取hive数据库的方式,其中还是存在一些坑,这里我也把自己遇到的进行分享交流。 基本情况 集团有20台服务器(其中1台采集主节点,1台大数据监控平台,1台资源监控) ...

介绍了数据库和数据表的增删改查

Hive属于数据仓库的概念范畴,主要用于进行数据分析用,不适合实时数据查询。可以完成海量数据的存储,存储在HDFS上,不需要类似关系数据库那样的固定格式限制,对应的...Hive 定义了简单的类 SQL 查询语言,称为 QL,

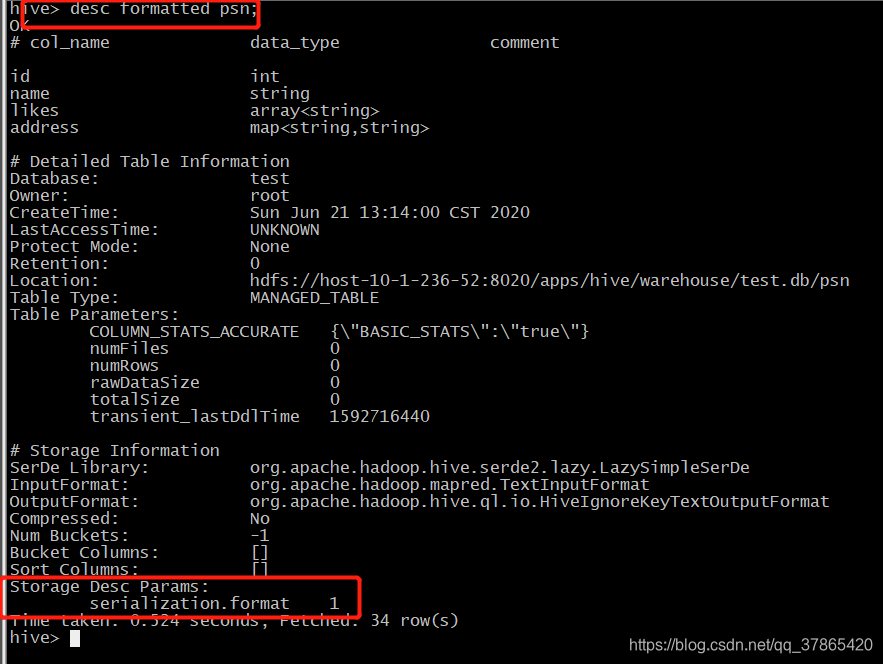

针对hive各种数据库操作,内部表、外部表、分区表、分桶表的表属性查看修改操作以及hive数据的导入与导出详解。

import pandas as pd ...class Hive: def __init__(self, host, port=1050): self.conn = connect(host, port) self.cursor = self.conn.cursor() def close(self): self.cursor.close() self.conn.

原文:https://www.cnblogs.com/HondaHsu/p/4346354.html1.先...drop table sfmk.xzz_0726_srcarea_desarea; create table sfmk.xzz_0726_srcarea_desarea ( srcarea_desarea string ) row format delimited fields ter

数据库是长期存放在计算机内、有组织的、可共享的大量数据的集合。数据库中的数据按照一定的数据模型组织、描述和储存,具有较小的冗余度、较高的数据独立性和易拓展性,并可为各种用户共享。主要分为关系型数据库和...

from pyhive import hive import pandas as pd import key_one class LinkHive(object): def __init__(self,host,port,username,password,database): self.host = host self.port = port self.username = ...

推荐文章

- ES6-17【类、类的继承、类的实现、类的修饰】_es6 类修饰 详解-程序员宅基地

- Java 常用类 03 可变字符串和BigDecimal(BigInteger)_java字符串和bigdecimal类-程序员宅基地

- 【基于FPGA的芯片设计】32×32位寄存器堆_fpga2s需要多少位寄存器-程序员宅基地

- STM32F103 软件实现随机数_stm32f103c8t6可以生成随机数么-程序员宅基地

- 微信h5页面打开微信内置地图及wx.openLocation回调成功调不起页面的问题_h5 wx.openlocation-程序员宅基地

- Linux——部署DNS服务二: 正向解析,反向解析,双向解析_用于减少域名到ip地址的映射的技术是-程序员宅基地

- 学习使用idea搭建SSH框架,并实现一个简单的登录功能_intellij idea ssh 登录系统教程-程序员宅基地

- Golang编译选项(ldflags)有趣应用_golang ldflags-程序员宅基地

- WPF基础到企业应用系列6——布局全接触-程序员宅基地

- 关于深度学习人工智能模型的探讨(二)(1)_深度学习可以用不完备性定理解释么-程序员宅基地